Open WebUI¶

Open WebUI 是一个可扩展、功能丰富且用户友好的自托管 AI 平台,专为完全离线运行而设计。 它支持多种 LLM 运行器,如 Ollama 和 OpenAI 兼容 API,并具备内置的 RAG 功能,使其成为强大的 AI 部署解决方案。

要使用 vLLM 开始使用 Open WebUI,请按照以下步骤操作:

-

安装 Docker。

-

使用支持聊天完成的模型启动 vLLM 服务器:

-

启动 Open WebUI Docker 容器:

-

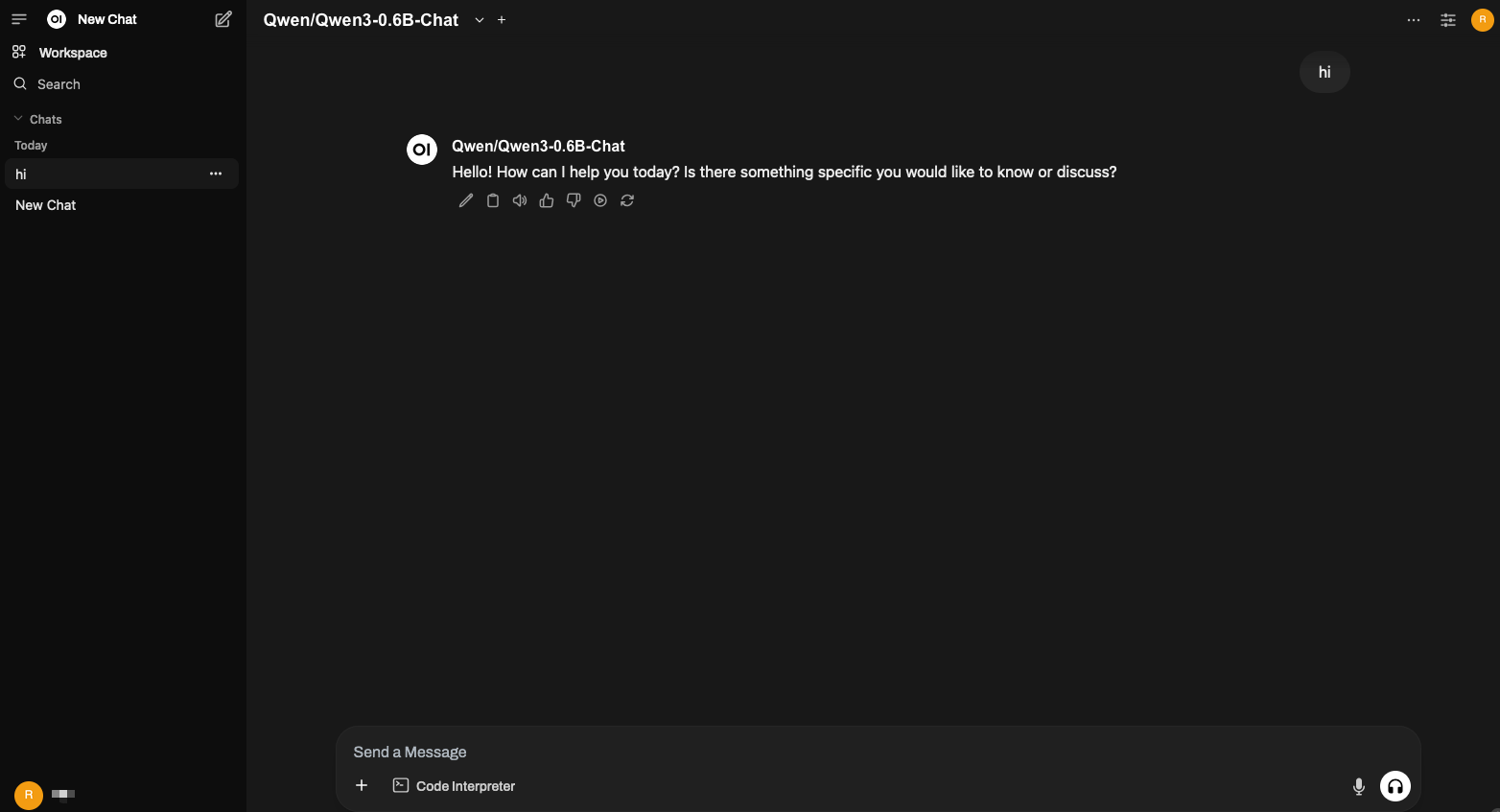

在浏览器中打开:http://open-webui-host:3000/

页面顶部您应该能看到模型

Qwen/Qwen3-0.6B-Chat。